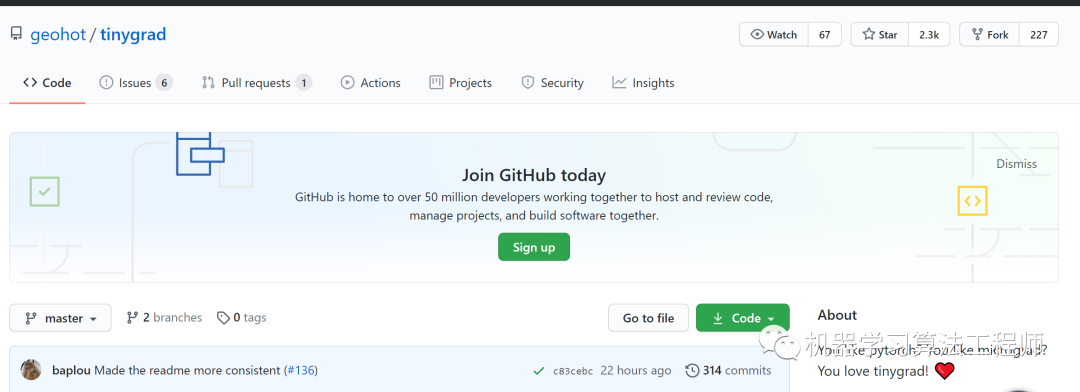

近期,一个不到1000行的深度学习框架tinygrad火了,麻雀虽小,但五脏俱全,这个深度学习框架使用起来和PyTorch类似,目前已经开源在GitHub上,而且收获了2.3K星:

其实我们当然不会用这样的框架来真正训练网络,但是1000行的代码量我们倒是可以稍微啃一下,对理解深度学习框架内部原理还是非常有帮助的,希望感兴趣的小伙伴们可以查阅。

tinygrad:不到1000行代码的深度学习框架,天才黑客开源GitHub 2.3k+ stars

来源:清泛编译 2021-01-04 10:07:01 人气: 我有话说( 0 人参与)

近期,一个不到1000行的深度学习框架tinygrad火了,麻雀虽小,但五脏俱全,这个深度学习框架使用起来和PyTorch类似,目前已经开源在GitHub上,而且收获了2 3K星:项目地址:https:

其实我们当然不会用这样的框架来真正训练网络,但是1000行的代码量我们倒是可以稍微啃一下,对理解深度学习框架内部原理还是非常有帮助的,希望感兴趣的小伙伴们可以查阅。